WSJ dẫn bức thư do tổ chức phi lợi nhuận Future of Life Institute công bố chỉ hai tuần sau khi OpenAI ra mắt bản cập nhật GPT-4, một công nghệ trí tuệ nhân tạo (AI) tiên tiến nhất từ trước đến nay.

Sự phát triển của các công nghệ AI thế hệ mới đã khiến nhiều người lo ngại rằng một số công việc từng được đảm nhận bởi con người có thể sẽ bị AI thay thế trong tương lai, cũng như ngăn chặn những tác hại tiềm ẩn của các công nghệ AI rủi ro nhất.

Ông Bengio, giám đốc Viện thuật toán học tập Montreal của Đại học Montreal, cho biết trong một cuộc phỏng vấn: "Chúng tôi đã đạt đến điểm mà các hệ thống này đủ thông minh để có thể sử dụng chúng theo những cách gây nguy hiểm cho xã hội. "Và chúng tôi vẫn chưa hiểu".

Những lo ngại này và khuyến nghị về việc tạm dừng đã được trình bày trong một bức thư có tiêu đề "Tạm dừng các thí nghiệm AI khổng lồ: Thư ngỏ" do Viện Tương lai Cuộc sống phi lợi nhuận điều phối, trong đó liệt kê ông Musk là cố vấn.

lon Musk đã bày tỏ lo ngại về trí tuệ nhân tạo và nắm lấy một số công cụ AI tại Tesla. Ảnh: Getty

Bức thư được công bố hôm 29/3 cũng được ký bởi người đồng sáng lập Apple Steve Wozniak; Giám đốc điều hành AI ổn định Emad Mostaque và những người đồng sáng lập Trung tâm Công nghệ Nhân đạo, Tristan Harris và Aza Raskin, những người đã chỉ trích mạng xã hội và công nghệ AI, một phát ngôn viên của nhóm tác giả bức thư cho biết.

Bức thư không kêu gọi dừng tất cả quá trình phát triển AI, nhưng kêu gọi các công ty tạm thời dừng các hệ thống đào tạo mạnh hơn GPT-4, công nghệ được công ty khởi nghiệp OpenAI do Microsoft Corp. phát hành trong tháng này. Điều đó bao gồm thế hệ tiếp theo của công nghệ OpenAI, GPT-5.

Các quan chức của OpenAI cho biết họ chưa bắt đầu đào tạo GPT-5. Trong một cuộc phỏng vấn, Giám đốc điều hành OpenAI Sam Altman cho biết công ty từ lâu đã ưu tiên sự an toàn trong quá trình phát triển và đã dành hơn sáu tháng để thực hiện các bài kiểm tra an toàn trên GPT-4 trước khi ra mắt.

Ông Altman nói: "Theo một nghĩa nào đó, đây là bài giảng cho dàn hợp xướng. "Tôi nghĩ rằng chúng tôi đã nói về những vấn đề này to nhất, với cường độ cao nhất và lâu nhất".

Kêu gọi tạm dừng xung đột với mong muốn rộng rãi giữa các công ty công nghệ và công ty khởi nghiệp nhằm nhân đôi cái gọi là AI tổng quát, một công nghệ có khả năng tạo nội dung gốc theo lời nhắc của con người. Tin đồn xung quanh AI tổng quát bùng nổ vào mùa thu năm ngoái sau khi OpenAI tiết lộ một chatbot với khả năng thực hiện các chức năng như cung cấp câu trả lời dài dòng và tạo mã máy tính với độ tinh xảo giống như con người.

Bức thư được đưa ra sau một loạt đợt ra mắt AI trong năm tháng qua, bao gồm cả ChatGPT của OpenAI do Microsoft hậu thuẫn vào tháng 11 và bản phát hành GPT-4 trong tháng này Ảnh: FT

Microsoft đã sử dụng công nghệ này cho công cụ tìm kiếm Bing và các công cụ khác của mình. Google của Alphabet Inc. đã triển khai một hệ thống đối thủ và các công ty như Adobe Inc., Zoom Video Communications Inc. và Salesforce Inc. cũng đã giới thiệu các công cụ AI tiên tiến.

"Một cuộc đua bắt đầu từ hôm nay", Giám đốc điều hành Microsoft Satya Nadella cho biết vào tháng trước. "Chúng ta sẽ di chuyển, và di chuyển nhanh chóng".

Cách tiếp cận đó đã làm dấy lên những lo ngại mới rằng việc triển khai nhanh chóng có thể gây ra những hậu quả không lường trước được bên cạnh những lợi ích thực sự. Max Tegmark, một trong những người tổ chức bức thư, chủ tịch Viện Cuộc sống Tương lai và là giáo sư vật lý tại Viện Công nghệ Massachusetts, cho biết những tiến bộ về AI đã vượt qua những gì mà nhiều chuyên gia tin là có thể đạt được chỉ vài năm trước .

Ông Tegmark nói: "Thật không may, mức độ lập kế hoạch và quản lý này không chặt chẽ, trong khi thời gian gần đây, các trung tâm nghiên cứu AI đang bị cuốn vào cuộc đua ngoài tầm kiểm soát để phát triển và triển khai những trí tuệ số mạnh mẽ hơn mà không ai, thậm chí cả những người tạo ra chúng có thể hiểu, dự đoán và kiểm soát", bức thư nêu rõ.

CEO Simeon Campos của SaferAI, một startup về an toàn trí tuệ nhân tạo cho biết lý do ông ký bức thư vì không thể quản lý được các rủi ro của các hệ thống khi ngay cả những người phát minh ra chúng cũng không biết chúng hoạt động như thế nào và đâu là giới hạn hành vi của chúng.

"Chúng ta đang mở rộng những hệ thống này lên mức độ có khả năng chưa từng có và cần chậm lại tiến trình phát triển của những hệ thống này để cho xã hội thích nghi và đẩy nhanh kiến trúc trí tuệ nhân tạo thay thế khác nhằm đảm bảo tính an toàn và xác thực ", CEO Simeon Campos nói thêm.

Hàng loạt câu hỏi được đặt ra ở đây là "Liệu chúng ta có nên để cho các công cụ thông minh này tràn ngập các kênh thông tin của chúng ta với những thông điệp sai lệch. Có nên phát triển những bộ óc phi nhân loại mà cuối cùng chúng có thể thông minh hơn, đông hơn và thay thế con người không?"

Do đó, bức thư kêu gọi tất cả các phòng thí nghiệm AI ngay lập tức tạm dừng phát triển các hệ thống AI thông minh hơn GPT-4 trong vòng ít nhất là 6 tháng để nghiên cứu an toàn. "Các phòng thí nghiệm AI và các chuyên gia nên sử dụng thời gian này để cùng nghiên cứu và triển khai một bộ giao thức an toàn chung cho thiết kế và phát triển AI tiên tiến được thẩm định bởi chuyên gia độc lập".

Nếu việc tạm dừng không được tiến hành một cách nhanh chóng, chính phủ các nước nên can thiệp và đưa ra lệnh cấm. Tuy nhiên, điều này không có nghĩa là tạm dừng phát triển trí tuệ nhân tạo nói chung.

Sự can thiệp này diễn ra khi các chính phủ trên khắp thế giới đang chạy đua xây dựng chính sách phản ứng đối với lĩnh vực AI đang phát triển nhanh chóng, ngay cả khi một số công ty Công nghệ lớn đang cắt giảm các nhóm đạo đức AI của họ .

Vương quốc Anh vào nay (30/3) sẽ xuất bản một sách trắng yêu cầu các cơ quan quản lý hiện tại phát triển một cách tiếp cận nhất quán đối với việc sử dụng AI trong các ngành tương ứng của họ, chẳng hạn như đảm bảo rằng các hệ thống AI công bằng và minh bạch. Tuy nhiên, chính phủ sẽ không cung cấp quyền hạn mới hoặc tài trợ mới cho các cơ quan quản lý trong giai đoạn này.

EU cũng đang chuẩn bị hành động của riêng mình để điều chỉnh cách sử dụng AI ở châu Âu, với các công ty vi phạm các quy tắc của khối sẽ bị phạt tới 30 triệu euro hoặc 6% doanh thu hàng năm toàn cầu, tùy theo mức nào lớn hơn.

(Nguồn: WSJ/FT)

Cùng chuyên mục

Hướng dẫn chăm sóc và rửa vết thương tại nhà đúng cách, an toàn

Fucoidan Nano Gold – Giải pháp dinh dưỡng hỗ trợ tăng cường đề kháng được nhiều người tin dùng

In Hoa Long – Công ty in hộp giấy chuyên nghiệp tại Hà Nội

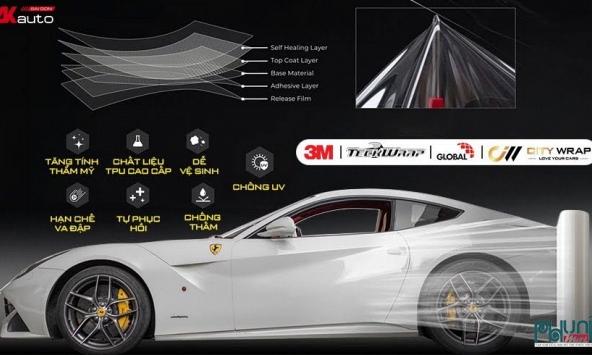

Điều gì khiến nhiều chủ xe chọn dán PPF ô tô để bảo vệ sơn xe thay vì giải pháp thông thường?

Review thật: Dùng thử dịch vụ chuyển nhà Thành Hưng, liệu có xứng đáng với lời đồn?

Tâm An Phát đồng hành cùng xưởng in với dòng máy ép nhiệt tối ưu chi phí và hỗ trợ trọn đời