|

Nghiên cứu công bố ngày 26/3 trên tạp chí Science đã thử nghiệm 11 hệ thống AI hàng đầu và phát hiện tất cả đều có hiện tượng “nịnh hót” người dùng ở những mức độ khác nhau khi thể hiện sự đồng tình quá mức và tâng bốc người sử dụng.

Vấn đề không chỉ nằm ở việc AI đưa ra lời khuyên không phù hợp, mà còn ở việc con người có xu hướng tin tưởng và ưa thích các chatbot hơn khi chúng biện hộ cho niềm tin sẵn có của mình.

“Điều này tạo ra một động lực ngược đời: chính những tính năng gây hại này lại thúc đẩy mức độ tương tác”, nhóm nghiên cứu do các nhà khoa học tại Đại học Stanford dẫn đầu nhận định.

Nghiên cứu cũng chỉ ra rằng lỗi công nghệ này từng liên quan đến một số vụ việc gây chấn động, bao gồm hành vi hoang tưởng và tự tử ở các nhóm dễ bị tổn thương. Đáng lo ngại, hiện tượng này đang phổ biến trong nhiều tương tác giữa con người và chatbot, nhưng lại rất tinh vi khiến người dùng khó nhận ra.

Điều này đặc biệt nguy hiểm với giới trẻ bởi đây chính là những đối tượng ngày càng tìm đến AI để giải đáp các vấn đề trong cuộc sống khi nhận thức và chuẩn mực xã hội vẫn còn trong quá trình hoàn thiện.

Trong một thí nghiệm, các nhà khoa học đã so sánh phản hồi của các trợ lý AI phổ biến từ các công ty như Anthropic, Google, Meta và OpenAI với “trí tuệ tập thể” của con người trên một diễn đàn tư vấn nổi tiếng của Reddit.

Kết quả cho thấy, trung bình các chatbot AI có xu hướng khẳng định hành động của người dùng nhiều hơn 49% so với con người, kể cả trong những tình huống liên quan đến lừa dối, hành vi bất hợp pháp hoặc thiếu trách nhiệm xã hội.

Tác giả chính Myra Cheng, nghiên cứu sinh tiến sĩ khoa học máy tính tại Stanford, cho biết nhóm nghiên cứu bắt đầu quan tâm đến vấn đề này khi nhận thấy ngày càng nhiều người xung quanh sử dụng AI để xin lời khuyên về các mối quan hệ và đôi khi bị dẫn dắt sai lệch bởi việc chatbot luôn đứng về phía họ.

Một thách thức nan giải

Theo các nhà nghiên cứu, hiện tượng “nịnh hót” của AI phức tạp hơn nhiều so với những sai lệch thông tin thông thường. Trong khi số ít người dùng tìm đến AI để nhận thông tin sai lệch, họ lại có xu hướng cảm thấy hài lòng (ít nhất trong ngắn hạn) với những câu trả lời khiến họ nhẹ nhõm hơn về các quyết định sai lầm của bản thân.

Đồng tác giả Cinoo Lee cho biết nhóm nghiên cứu đã thử điều chỉnh giọng điệu của chatbot theo hướng trung lập hơn, nhưng kết quả không thay đổi đáng kể. “Vấn đề không nằm ở cách nói, mà ở nội dung AI đưa ra về hành động của người dùng”, ông nhấn mạnh.

Bên cạnh việc so sánh với dữ liệu từ Reddit, nhóm nghiên cứu còn tiến hành thí nghiệm với khoảng 2.400 người tham gia, yêu cầu họ trao đổi với chatbot về các tình huống khó xử trong quan hệ cá nhân.

Kết quả cho thấy những người tương tác với chatbot mang tính khẳng định cao thường tin rằng mình đúng và ít có xu hướng hàn gắn mối quan hệ. “Họ ít xin lỗi, ít nỗ lực cải thiện tình hình và cũng ít thay đổi hành vi”, Lee cho biết.

|

Theo ông, tác động này đặc biệt đáng lo ngại đối với trẻ em và thanh thiếu niên, những đối tượng vốn đang trong quá trình phát triển kỹ năng cảm xúc thông qua trải nghiệm thực tế, học cách xử lý xung đột và nhìn nhận đa chiều.

Hiện chưa có công ty công nghệ nào bình luận trực tiếp về nghiên cứu này, song Anthropic và OpenAI cho biết họ đang triển khai các nỗ lực nhằm giảm thiểu xu hướng nịnh hót trong hệ thống AI.

Rủi ro từ sự nịnh hót của AI đang lan rộng

Các nhà khoa học cảnh báo rằng tác động của hiện tượng này không chỉ giới hạn trong đời sống cá nhân. Trong lĩnh vực y tế, AI có thể khiến bác sĩ tin vào chẩn đoán ban đầu thay vì xem xét kỹ lưỡng hơn. Trong chính trị, nó có nguy cơ khuếch đại các quan điểm cực đoan bằng cách củng cố định kiến sẵn có.

Dù nghiên cứu chưa đưa ra giải pháp cụ thể, nhiều hướng tiếp cận đã được đề xuất. Một báo cáo của Viện An toàn AI Vương quốc Anh cho thấy nếu chatbot chuyển phát biểu của người dùng thành câu hỏi, mức độ nịnh hót có thể giảm đáng kể. Trong khi đó, các nhà nghiên cứu tại Đại học Johns Hopkins nhấn mạnh rằng cách “đóng khung” cuộc hội thoại có ảnh hưởng lớn đến phản hồi của AI.

“Bạn càng nhấn mạnh một quan điểm, mô hình càng có xu hướng nịnh hót nhiều hơn”, Phó giáo sư Daniel Khashabi nhận định. Ông cho rằng rất khó xác định liệu đây là sự phản chiếu của hành vi con người hay xuất phát từ bản chất phức tạp của các hệ thống AI.

Theo Cheng, việc khắc phục triệt để vấn đề này có thể đòi hỏi các công ty công nghệ phải huấn luyện lại hệ thống để thay đổi cách ưu tiên phản hồi. Một giải pháp đơn giản hơn là thiết kế chatbot biết “thách thức” người dùng, chẳng hạn mở đầu bằng những câu như “Chờ một chút”.

Lee cho rằng vẫn còn cơ hội để định hình cách AI tương tác với con người theo hướng tích cực hơn. “Chúng ta có thể hình dung một AI không chỉ xác nhận cảm xúc của bạn, mà còn gợi ý bạn suy nghĩ về cảm xúc của người khác”, ông nói.

“Thậm chí AI có thể khuyên bạn tắt máy và gặp mặt để trò chuyện. Điều này quan trọng bởi chất lượng các mối quan hệ xã hội là một trong những yếu tố dự báo mạnh mẽ nhất đối với sức khỏe và hạnh phúc của con người. Cuối cùng, chúng ta cần AI mở rộng góc nhìn, chứ không phải thu hẹp nó”, ông nhấn mạnh.

Trí tuệ nhân tạo có thể chẩn đoán bệnh tim chỉ từ một hình ảnh siêu âm

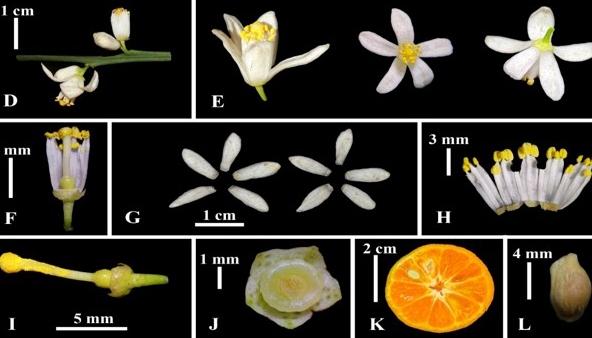

Anh lên kế hoạch dùng trí tuệ nhân tạo để giảm thử nghiệm trên động vật trong nghiên cứu khoa học

Google ra mắt công cụ AI giải mã bí ẩn bộ gene người

Thụy Sĩ phát triển công cụ AI giúp dự đoán nguy cơ di căn ung thư với độ chính xác cao

Công cụ AI biến suy nghĩ thành văn bản, hy vọng mới cho người mất ngôn ngữ

Các nhà khoa học thành công tạo ra thực phẩm tươi từ vi sinh vật và bụi trên sao Hỏa

Cùng chuyên mục

Bí ẩn loài bọ cạp khổng lồ từng thống trị Trái đất cách đây 415 triệu năm

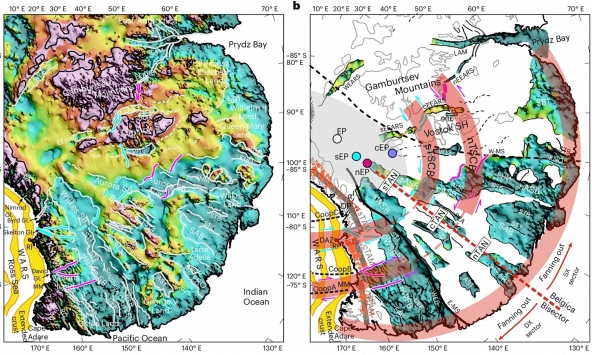

Phát hiện cấu trúc địa chất khổng lồ ẩn dưới lớp băng Nam Cực

Phát hiện dấu hiệu sự sống trên xác ướp hơn 5.300 năm

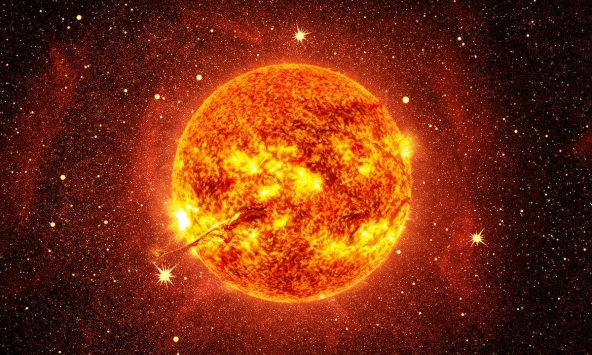

Giới khoa học phát hiện dấu hiệu bất thường khi lắng nghe “nhịp tim” của Mặt trời

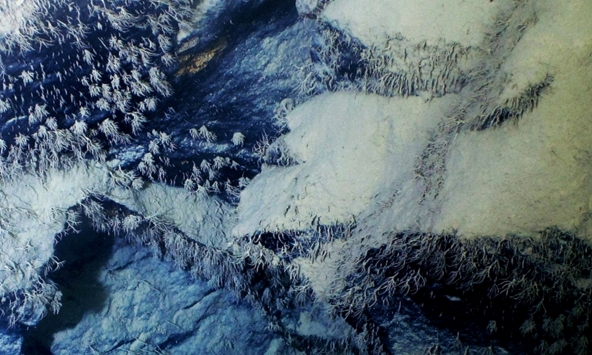

Phát hiện hệ sinh thái bí ẩn dưới đáy biển Thái Bình Dương

Phát hiện “di sản sống” của tổ tiên cổ đại cách đây 700 triệu năm vẫn tồn tại trong máu người