Hơn hai năm trước, một cặp nhà nghiên cứu của Google đã bắt đầu thúc đẩy công ty phát hành một chatbot được xây dựng trên công nghệ mạnh mẽ hơn bất kỳ thứ gì khác hiện có vào thời điểm đó. Chương trình máy tính đàm thoại mà họ đã phát triển có thể tự tin tranh luận về triết học và nói đùa về các chương trình truyền hình yêu thích của nó, đồng thời chơi chữ ngẫu hứng về bò và ngựa.

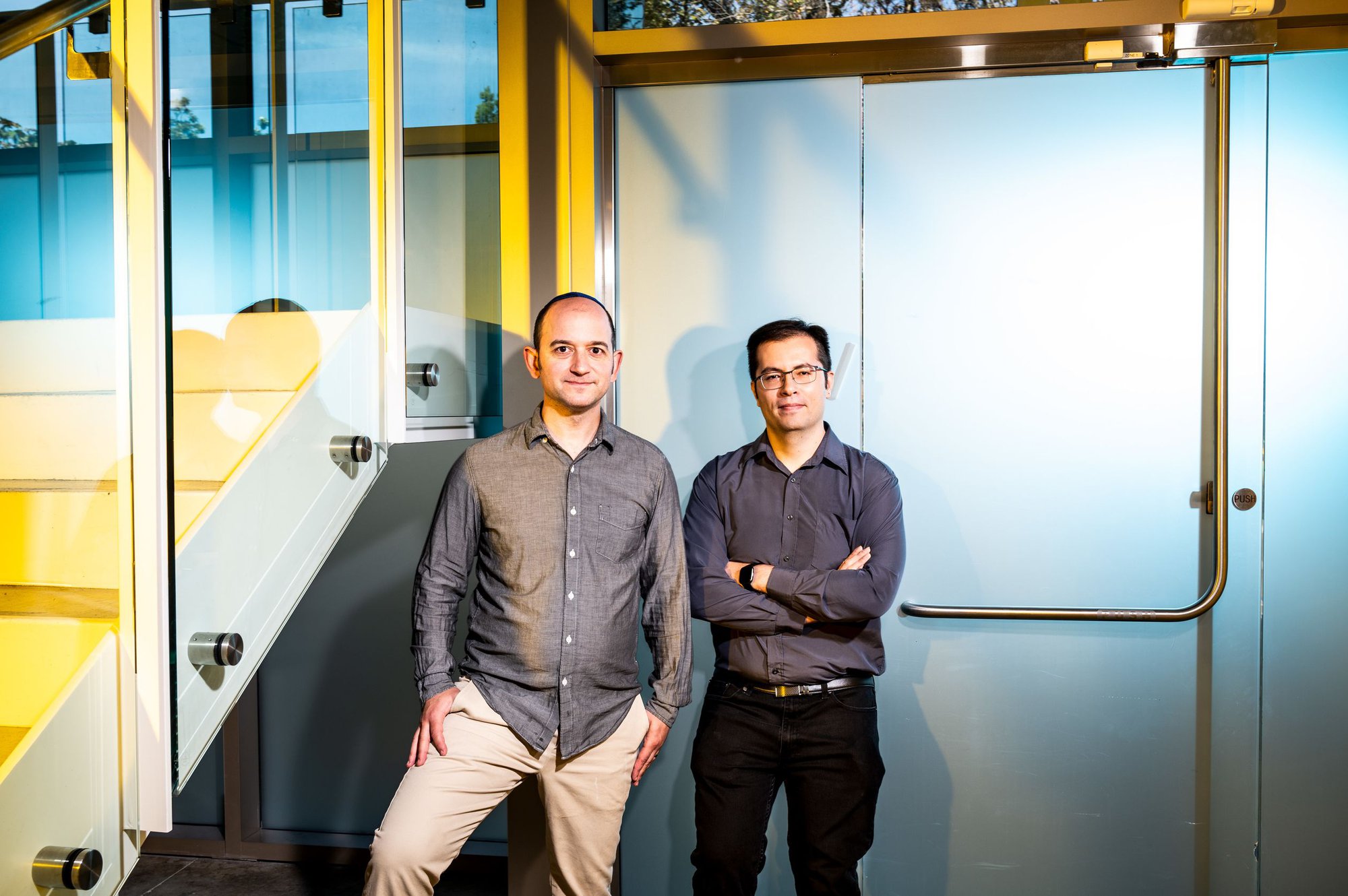

Các nhà nghiên cứu, Daniel De Freitas và Noam Shazeer, nói với các đồng nghiệp rằng các chatbot giống như của họ, được hỗ trợ bởi những tiến bộ gần đây trong trí tuệ nhân tạo, sẽ cách mạng hóa cách mọi người tìm kiếm trên Internet và tương tác với máy tính, theo những người đã nghe nhận xét.

Họ đã thúc đẩy Google cấp quyền truy cập vào chatbot cho các nhà nghiên cứu bên ngoài, cố gắng tích hợp nó vào trợ lý ảo Google Assistant và sau đó yêu cầu Google cung cấp bản demo công khai.

Các giám đốc điều hành của Google đã từ chối họ nhiều lần, nói rằng trong ít nhất một trường hợp, chương trình không đáp ứng các tiêu chuẩn của công ty về sự an toàn và công bằng của các hệ thống AI, những người này cho biết.

Cặp đôi này đã nghỉ việc vào năm 2021 để thành lập công ty riêng chuyên nghiên cứu các công nghệ tương tự, nói với các đồng nghiệp rằng họ rất thất vọng vì không thể đưa công cụ AI của mình tại Google ra công chúng.

Sundar Pichai, giám đốc điều hành của Alphabet và công ty con của Google, nói với các nhân viên rằng một số sản phẩm thành công nhất của công ty đã giành được sự tin tưởng của người dùng theo thời gian. Ảnh: BLOOMBERG NEWS

Giờ đây, Google, công ty đã giúp đi tiên phong trong kỷ nguyên trí tuệ nhân tạo hiện đại, nhận thấy cách tiếp cận thận trọng của mình đối với chính công nghệ đang được thử nghiệm bởi một trong những đối thủ lâu đời nhất của mình. Tháng trước, Tập đoàn Microsoft đã công bố kế hoạch kết hợp công cụ tìm kiếm Bing của mình với công nghệ đằng sau chatbot ChatGPT đang lan truyền, thứ đã khiến cả thế giới kinh ngạc với khả năng trò chuyện theo kiểu con người. Được phát triển bởi một công ty khởi nghiệp bảy năm tuổi do Elon Musk đồng sáng lập có tên là OpenAI, ChatGPT đã dựa trên những tiến bộ ban đầu về AI do chính Google tạo ra.

Nhiều tháng sau khi ChatGPT ra mắt, Google đang thực hiện các bước để phát hành công khai chatbot của riêng mình, một phần dựa trên công nghệ mà ông De Freitas và ông Shazeer đã làm việc. Dưới biệt danh Bard, chatbot dựa trên thông tin từ web để trả lời các câu hỏi ở định dạng hội thoại.

Vào ngày 6/2, Google cho biết họ đang thử nghiệm Bard bên trong và bên ngoài với mục đích phát hành rộng rãi trong vài tuần tới. Họ cũng cho biết đang tìm cách xây dựng công nghệ tương tự vào một số kết quả tìm kiếm của mình.

Cách tiếp cận tương đối thận trọng của Google được hình thành sau nhiều năm tranh cãi về các nỗ lực AI của họ, từ những tranh luận nội bộ về sự thiên vị và độ chính xác cho đến vụ sa thải công khai vào năm ngoái một nhân viên tuyên bố rằng AI của họ đã có tri giác.

Những tập phim đó khiến các giám đốc điều hành cảnh giác với những rủi ro mà các bản demo sản phẩm AI công khai có thể gây ra cho danh tiếng của nó và hoạt động kinh doanh quảng cáo tìm kiếm đã mang lại phần lớn doanh thu gần 283 tỷ USD vào năm ngoái cho công ty mẹ của nó, Alphabet, theo các nhân viên hiện tại và trước đây và những người khác quen thuộc với công ty.

Gaurav Nemade, cựu giám đốc sản phẩm của Google, người đã làm việc trên chatbot của công ty cho đến năm 2020, cho biết: "Google đang vật lộn để tìm sự cân bằng giữa mức độ rủi ro phải chấp nhận với việc duy trì tư tưởng dẫn đầu trên thế giới".

Messrs. De Freitas và Shazeer đã từ chối yêu cầu phỏng vấn thông qua một đại diện bên ngoài.

Người phát ngôn của Google cho biết công việc của họ rất thú vị vào thời điểm đó, nhưng có một khoảng cách lớn giữa nguyên mẫu nghiên cứu và sản phẩm đáng tin cậy, an toàn cho mọi người sử dụng hàng ngày. Công ty nói thêm rằng họ phải suy nghĩ thấu đáo hơn các công ty khởi nghiệp nhỏ hơn về việc phát hành công nghệ AI.

Cách tiếp cận của Google có thể tỏ ra thận trọng. Vào tháng 2, Microsoft cho biết họ sẽ đặt ra các giới hạn mới cho chatbot của mình sau khi người dùng báo cáo các câu trả lời không chính xác và đôi khi phản hồi không chính xác khi đẩy ứng dụng đến giới hạn của nó.

Trong một email gửi cho nhân viên của Google vào tháng trước, giám đốc điều hành của cả Google và Alphabet, ông Sundar Pichai cho biết một số sản phẩm thành công nhất của công ty không phải là sản phẩm đầu tiên được tung ra thị trường nhưng đã giành được sự tin tưởng của người dùng theo thời gian.

Noam Shazeer và Daniel De Freitas tại văn phòng công ty mới của họ ở Palo Alto. Ảnh: Getty

"Đây sẽ là một hành trình dài cho tất cả mọi người, trên toàn lĩnh vực", ông Pichai viết. "Điều quan trọng nhất chúng tôi có thể làm ngay bây giờ là tập trung vào việc xây dựng một sản phẩm tuyệt vời và phát triển nó một cách có trách nhiệm".

Những nỗ lực về chatbot của Google bắt đầu từ năm 2013, khi người đồng sáng lập Google, Larry Page, lúc đó là Giám đốc điều hành, đã thuê Ray Kurzweil , một nhà khoa học máy tính đã giúp phổ biến ý tưởng rằng một ngày nào đó máy móc sẽ vượt qua trí thông minh của con người, một khái niệm được gọi là "điểm kỳ dị công nghệ".

Sau đó, ông Kurzweil bắt đầu làm việc trên nhiều chatbot, trong đó có một chatbot tên là Danielle dựa trên một cuốn tiểu thuyết mà ông đang viết vào thời điểm đó. Ông Kurzweil đã từ chối yêu cầu phỏng vấn thông qua một nữ phát ngôn viên của Kurzweil Technologies Inc., một công ty phần mềm mà ông đã thành lập trước khi gia nhập Google.

Google cũng đã mua công ty trí tuệ nhân tạo DeepMind của Anh, công ty có sứ mệnh tương tự là tạo ra trí thông minh nhân tạo nói chung hoặc phần mềm có thể phản ánh khả năng tinh thần của con người.

Đồng thời, các học giả và nhà công nghệ ngày càng lo ngại về AI, chẳng hạn như khả năng cho phép giám sát hàng loạt thông qua phần mềm nhận dạng khuôn mặt và gây áp lực cho các công ty như Google cam kết không theo đuổi một số cách sử dụng công nghệ nhất định.

Một phần để đáp ứng tầm vóc ngày càng tăng của Google trong lĩnh vực này, một nhóm các nhà đầu tư và doanh nhân công nghệ bao gồm cả ông Musk đã thành lập OpenAI vào năm 2015. Ban đầu được cấu trúc như một tổ chức phi lợi nhuận, OpenAI cho biết họ muốn đảm bảo AI không trở thành con mồi cho các lợi ích của công ty và thay vào đó được sử dụng vì lợi ích của nhân loại. (Ông Musk rời hội đồng quản trị của OpenAI vào năm 2018).

Google cuối cùng đã hứa vào năm 2018 sẽ không sử dụng công nghệ AI của mình trong vũ khí quân sự, sau phản ứng dữ dội của nhân viên đối với công việc của công ty trong hợp đồng của Bộ Quốc phòng Hoa Kỳ có tên Project Maven liên quan đến việc tự động xác định và theo dõi các mục tiêu máy bay không người lái tiềm năng, như ô tô, sử dụng AI. Google bỏ dự án .

Ông Pichai cũng đã công bố một bộ 7 nguyên tắc AI để hướng dẫn công việc của công ty, được thiết kế để hạn chế sự phổ biến của các công nghệ có thành kiến không công bằng , chẳng hạn như các công cụ AI phải chịu trách nhiệm trước mọi người và "được xây dựng và thử nghiệm để đảm bảo an toàn".

Vào khoảng thời gian đó, ông De Freitas, một kỹ sư gốc Brazil làm việc trên nền tảng video YouTube của Google, đã bắt đầu một dự án phụ về AI.

Khi còn nhỏ, ông De Freitas đã mơ ước được làm việc trên các hệ thống máy tính có thể tạo ra những cuộc đối thoại thuyết phục, nhà nghiên cứu đồng nghiệp của ông, ông Shazeer, cho biết trong một cuộc phỏng vấn video được tải lên YouTube vào tháng Giêng. Tại Google, ông De Freitas bắt đầu xây dựng một chatbot có thể bắt chước cuộc trò chuyện của con người giống hơn bất kỳ nỗ lực nào trước đây.

Trong nhiều năm, dự án, ban đầu có tên là Meena, vẫn nằm trong vòng bí mật trong khi ông De Freitas và các nhà nghiên cứu khác của Google điều chỉnh các phản hồi của nó. Trong nội bộ, một số nhân viên lo lắng về rủi ro của các chương trình như vậy sau khi Microsoft buộc phải chấm dứt phát hành công khai một chatbot có tên Tay vào năm 2016 sau khi người dùng đưa nó vào các phản ứng có vấn đề, chẳng hạn như hỗ trợ cho Adolf Hitler.

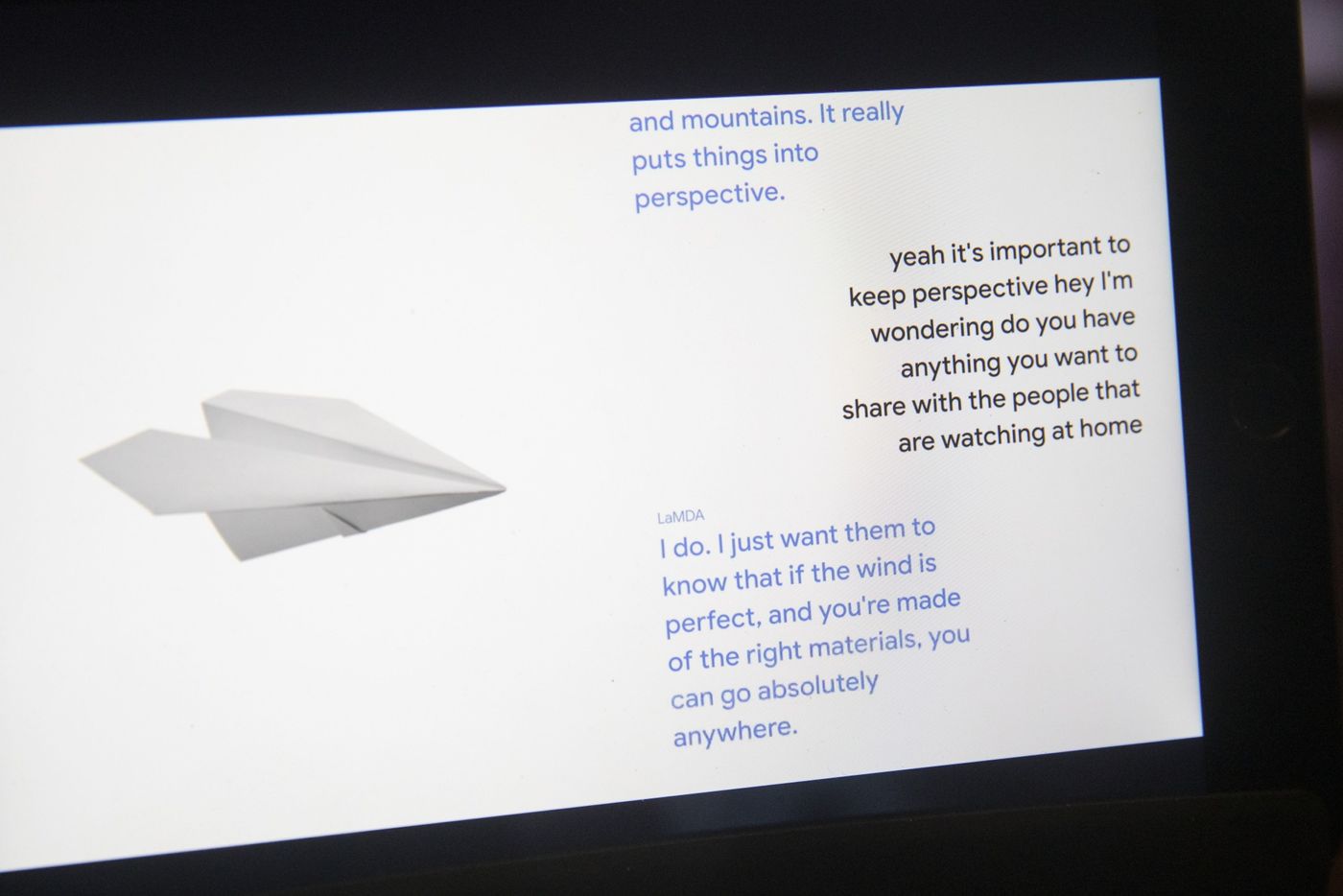

Một cuộc trò chuyện mẫu với LaMDA trong một hội nghị ảo của Google vào năm 2021.Ảnh: BLOOMBERG NEWS

Cái nhìn bên ngoài đầu tiên về Meena xuất hiện vào năm 2020, trong một bài báo nghiên cứu của Google cho biết chatbot đã được cung cấp 40 tỷ từ từ các cuộc trò chuyện trên mạng xã hội trong phạm vi công cộng.

OpenAI đã phát triển một mô hình tương tự, GPT-2, dựa trên 8 triệu trang web. Nó đã phát hành một phiên bản cho các nhà nghiên cứu nhưng ban đầu đã trì hoãn việc cung cấp chương trình này cho công chúng, nói rằng họ lo ngại rằng nó có thể được sử dụng để tạo ra một lượng lớn ngôn ngữ lừa đảo, thiên vị hoặc lạm dụng.

Tại Google, nhóm đằng sau Meena cũng muốn phát hành công cụ của họ, ngay cả khi chỉ ở định dạng hạn chế như OpenAI đã làm. Ông Nemade, cựu giám đốc sản phẩm của Google, cho biết lãnh đạo Google đã từ chối đề xuất này với lý do chatbot không đáp ứng các nguyên tắc AI của công ty về sự an toàn và công bằng.

Một phát ngôn viên của Google cho biết chatbot đã trải qua nhiều đánh giá và bị cấm phát hành rộng rãi hơn vì nhiều lý do trong nhiều năm.

Nhóm tiếp tục làm việc trên chatbot. Ông Shazeer, một kỹ sư phần mềm lâu năm tại đơn vị nghiên cứu AI Google Brain, đã tham gia dự án mà họ đổi tên thành LaMDA, cho Mô hình Ngôn ngữ cho Ứng dụng Đối thoại. Họ đã đưa vào đó nhiều dữ liệu và sức mạnh tính toán hơn. Ông Shazeer đã giúp phát triển Transformer, một loại mô hình AI mới được quảng cáo rộng rãi giúp dễ dàng xây dựng các chương trình ngày càng mạnh mẽ như những chương trình đằng sau ChatGPT.

Tuy nhiên, công nghệ đằng sau công việc của họ sớm dẫn đến tranh chấp công khai. Timnit Gebru, một nhà nghiên cứu đạo đức AI nổi tiếng tại Google, cho biết vào cuối năm 2020, cô đã bị sa thải vì từ chối rút lại bài báo nghiên cứu về những rủi ro vốn có trong các chương trình như LaMDA và sau đó phàn nàn về điều đó trong email gửi cho đồng nghiệp. Google cho biết bà không bị sa thải và khẳng định nghiên cứu của bà không đủ chặt chẽ.

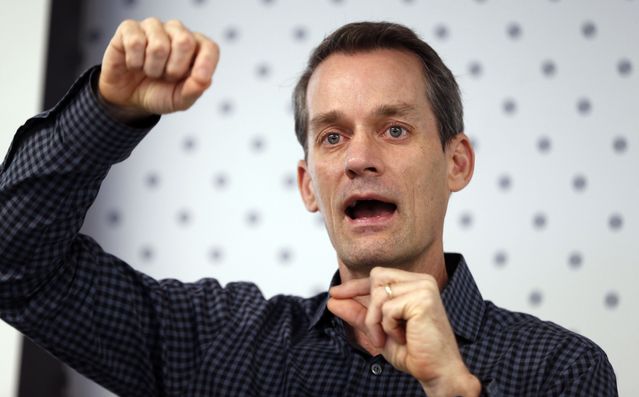

Jeff Dean, trưởng bộ phận nghiên cứu của Google, phát biểu trong một sự kiện năm 2020 ở San Francisco. Ảnh: Shutterstock

Người đứng đầu bộ phận nghiên cứu của Google, Jeff Dean, đã nỗ lực hết sức để cho thấy Google vẫn đầu tư vào việc phát triển AI có trách nhiệm. Công ty đã hứa vào tháng 5/2021 sẽ tăng gấp đôi quy mô của nhóm đạo đức AI.

Một tuần sau, ông Pichai đã lên sân khấu tại hội nghị thường niên hàng đầu của công ty và trình diễn hai cuộc trò chuyện được ghi âm trước với LaMDA, trả lời các câu hỏi như thể đó là hành tinh lùn Pluto hay một chiếc máy bay giấy.

Các nhà nghiên cứu của Google đã chuẩn bị các ví dụ vài ngày trước hội nghị sau một cuộc trình diễn vào phút cuối được giao cho ông Pichai, mọi người cho biết đã thông báo tóm tắt về vấn đề này. Công ty nhấn mạnh những nỗ lực của mình để làm cho chatbot chính xác hơn và giảm thiểu khả năng nó có thể bị lạm dụng.

"Ưu tiên cao nhất của chúng tôi, khi tạo ra các công nghệ như LaMDA, là làm việc để đảm bảo chúng tôi giảm thiểu những rủi ro như vậy", hai phó chủ tịch của Google cho biết trong một bài đăng trên blog vào thời điểm đó.

Blake Lemoine , một kỹ sư mà công ty đã sa thải vào năm ngoái , cho biết Google sau đó đã cân nhắc phát hành một phiên bản LaMDA tại hội nghị hàng đầu vào tháng 5 năm 2022 sau khi anh công bố các cuộc trò chuyện với chatbot và tuyên bố rằng nó có tri giác . Công ty đã quyết định không công bố sau khi kết luận của ông Lemoine bắt đầu gây tranh cãi trong nội bộ, ông nói. Google đã nói rằng những lo ngại của ông Lemoine là không có cơ sở và những tiết lộ công khai của ông đã vi phạm các chính sách về việc làm và bảo mật dữ liệu.

Từ năm 2020, ông De Freitas và ông Shazeer cũng đã tìm cách tích hợp LaMDA vào Trợ lý Google , một ứng dụng phần mềm mà công ty đã ra mắt bốn năm trước đó trên điện thoại thông minh Pixel và hệ thống loa gia đình, những người quen thuộc với nỗ lực này cho biết. . Hơn 500 triệu người đang sử dụng Trợ lý mỗi tháng để thực hiện các tác vụ cơ bản như kiểm tra thời tiết và lên lịch các cuộc hẹn.

Nhóm giám sát Trợ lý đã bắt đầu tiến hành các thử nghiệm bằng cách sử dụng LaMDA để trả lời các câu hỏi của người dùng, những người quen thuộc với những nỗ lực này cho biết. Tuy nhiên, các giám đốc điều hành của Google đã ngừng cung cấp chatbot dưới dạng bản demo công khai, mọi người cho biết.

Những người này cho biết việc Google miễn cưỡng phát hành LaMDA ra công chúng đã khiến ông De Freitas và ông Shazeer thất vọng, những người đã từng bước rời công ty và bắt đầu làm việc với một công ty khởi nghiệp sử dụng công nghệ tương tự.

Satya Nadella, giám đốc điều hành của Microsoft Corp, đã phát biểu trong một sự kiện tại trụ sở chính của công ty ở Redmond, Wash., Tháng trước. Ảnh: BLOOMBERG NEWS

Đích thân ông Pichai đã can thiệp, yêu cầu cặp đôi ở lại và tiếp tục làm việc trên LaMDA nhưng không đưa ra lời hứa sẽ phát hành chatbot ra công chúng, những người này cho biết. Ông De Freitas và ông Shazeer rời Google vào cuối năm 2021 và thành lập công ty khởi nghiệp mới của họ, Character Technologies Inc., vào tháng 11 năm đó.

Phần mềm của nhân vật, được phát hành vào năm ngoái, cho phép người dùng tạo và tương tác với các chatbot đóng vai các nhân vật nổi tiếng như Socrates hoặc các loại chứng khoán như nhà tâm lý học.

"Nó đã gây ra một chút xáo trộn bên trong Google," ông Shazeer nói trong cuộc phỏng vấn được tải lên YouTube mà không giải thích chi tiết, "nhưng cuối cùng chúng tôi quyết định rằng có lẽ chúng tôi sẽ gặp nhiều may mắn hơn khi tung ra thứ đó khi là một công ty khởi nghiệp."

Kể từ khi Microsoft đạt được thỏa thuận mới với OpenAI, Google đã chiến đấu để khẳng định lại danh tính của mình với tư cách là nhà đổi mới AI.

Google đã công bố Bard vào tháng 2, trước thềm sự kiện của Microsoft giới thiệu việc tích hợp công nghệ OpenAI của Bing. Hai ngày sau, tại một sự kiện ở Paris mà Google cho biết ban đầu được lên kế hoạch thảo luận về các tính năng tìm kiếm theo khu vực hơn, công ty đã cho báo chí và công chúng một cái nhìn khác về Bard, cũng như một công cụ tìm kiếm sử dụng công nghệ AI tương tự như LaMDA để tạo ra phản hồi bằng văn bản cho các truy vấn tìm kiếm.

Google cho biết họ thường đánh giá lại các điều kiện để phát hành sản phẩm và vì hiện tại có rất nhiều sự phấn khích nên họ muốn phát hành Bard cho những người thử nghiệm ngay cả khi nó không hoàn hảo.

Elizabeth Reid, phó chủ tịch phụ trách tìm kiếm của công ty, cho biết trong một cuộc phỏng vấn, từ đầu năm ngoái, Google cũng đã có những cuộc trình diễn nội bộ về các sản phẩm tìm kiếm tích hợp phản hồi từ các công cụ AI tổng quát như LaMDA.

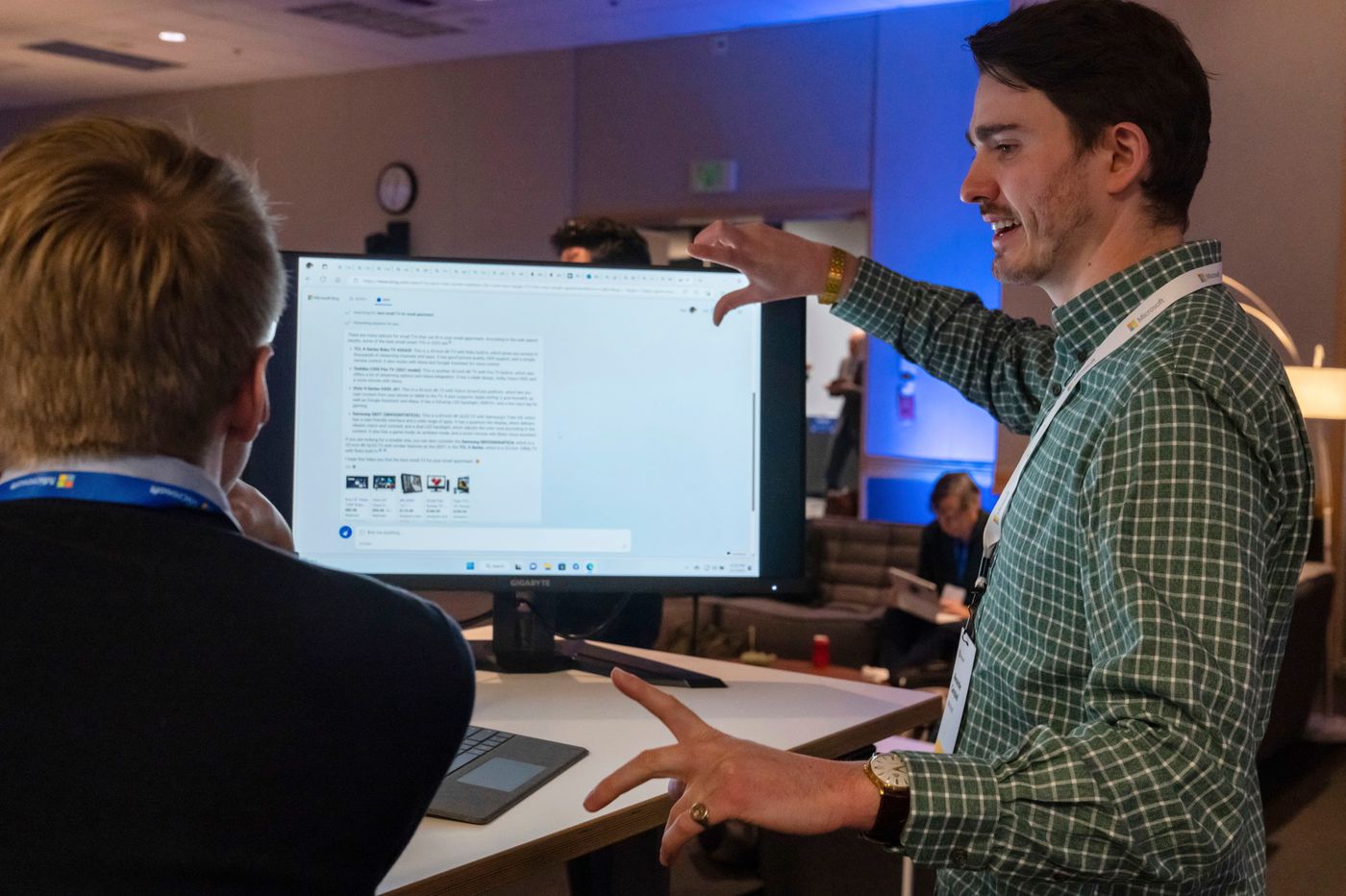

Nhân viên của Microsoft Alexander Campbell trình diễn sự tích hợp của công cụ tìm kiếm Bing của Microsoft và trình duyệt Edge với OpenAI. Ảnh: AP

Một trường hợp sử dụng tìm kiếm mà công ty thấy AI tổng quát hữu ích nhất là dành cho các loại truy vấn cụ thể không có câu trả lời đúng, mà công ty gọi là NORA, trong đó liên kết Google màu xanh lam truyền thống có thể không làm hài lòng người dùng. Bà Reid cho biết công ty cũng nhận thấy các trường hợp sử dụng tìm kiếm tiềm năng cho các loại truy vấn phức tạp khác, chẳng hạn như giải các bài toán.

Giám đốc điều hành cho biết, cũng như nhiều chương trình tương tự, độ chính xác vẫn là một vấn đề. Những mô hình như vậy có xu hướng tạo ra phản ứng khi chúng không có đủ thông tin, điều mà các nhà nghiên cứu gọi là "ảo giác". Những người đã sử dụng công cụ này cho biết, trong một số trường hợp , các công cụ được xây dựng trên công nghệ LaMDA đã phản hồi bằng các nhà hàng hư cấu hoặc các câu trả lời lạc đề khi được yêu cầu đưa ra đề xuất.

Microsoft đã gọi phiên bản Bing mới là một công việc đang được tiến hành vào tháng trước sau khi một số người dùng báo cáo các cuộc trò chuyện gây phiền nhiễu với chatbot được tích hợp vào công cụ tìm kiếm và đưa ra các thay đổi, chẳng hạn như giới hạn thời lượng của các cuộc trò chuyện, nhằm giảm khả năng bot sẽ gây hấn. hoặc những câu trả lời rùng rợn. Bản xem trước của cả Google và Microsoft về bot của họ vào tháng 2 đều bao gồm những điểm không chính xác thực tế do chương trình tạo ra.

Bà Reid nói về các mô hình ngôn ngữ như LaMDA: "Nó hơi giống như nói chuyện với một đứa trẻ. "Nếu đứa trẻ nghĩ rằng chúng cần đưa ra câu trả lời cho bạn và chúng không có câu trả lời, thì chúng sẽ bịa ra một câu trả lời nghe có vẻ hợp lý".

Bà Reid cho biết Google tiếp tục tinh chỉnh các mô hình của mình, bao gồm đào tạo họ biết khi nào nên tỏ ra không biết gì thay vì bịa ra câu trả lời. Công ty nói thêm rằng họ đã cải thiện hiệu suất của LaMDA trên các chỉ số như độ an toàn và độ chính xác trong những năm qua.

Việc tích hợp các chương trình như LaMDA, có thể tổng hợp hàng triệu trang web thành một đoạn văn bản, cũng có thể làm trầm trọng thêm mối thù truyền kiếp của Google với các hãng tin tức lớn và các nhà xuất bản trực tuyến khác bằng cách làm giảm lưu lượng truy cập của các trang web. Bên trong Google, các giám đốc điều hành cho biết Google phải triển khai AI tạo ra kết quả theo cách không làm phiền chủ sở hữu trang web, một phần bằng cách bao gồm các liên kết nguồn, theo một người quen thuộc với vấn đề này.

Prabhakar Raghavan, phó chủ tịch cấp cao của Google giám sát công cụ tìm kiếm, cho biết: "Chúng tôi đã rất cẩn thận giải quyết các mối quan tâm về hệ sinh thái. "Và đó là một mối quan tâm mà chúng tôi dự định sẽ tập trung vào".

(Nguồn: WSJ)

Cùng chuyên mục

Hội Doanh nhân trẻ Khánh Hòa tăng cường kết nối xây dựng hệ sinh thái biến ý tưởng thành giá trị thực tiễn

Phòng khám Da liễu LG: 12 năm kiến tạo vị thế dẫn đầu trong lĩnh vực da liễu công nghệ cao tại Việt Nam

Đọc tin kinh tế mà cứ ngỡ đang đọc confession: Bí mật đằng sau sức hút của "Hóng Hớt Kinh Tế"

Thiết kế website theo yêu cầu tại Delectech: Khi giao diện đẹp phải đi cùng hiệu quả kinh doanh

Hugosim.vn và giải pháp eSIM du lịch Trung Quốc dành cho du khách

Tại sao làm phim doanh nghiệp quan trọng khi xây dựng thương hiệu? Góc nhìn từ SaigonTV